Питерские ученые научили нейросеть читать эмоции по ЭЭГ работников

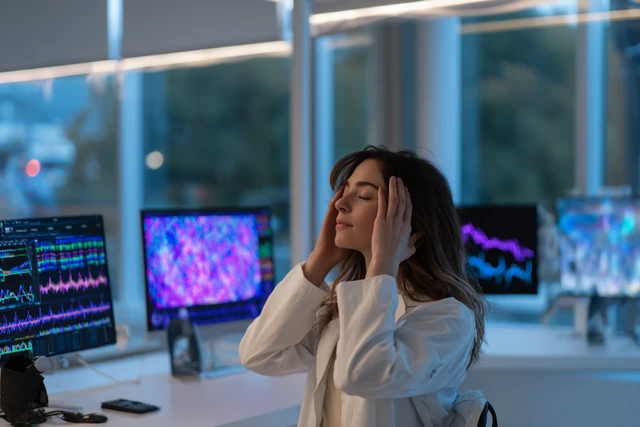

Исследователи Федерального исследовательского центра РАН (СПб ФИЦ РАН) создали нейросетевую модель, которая анализирует электроэнцефалограмму (ЭЭГ) в реальном времени. Сигналы снимаются неинвазивно с помощью компактных носимых устройств, без повреждения тканей. Модель классифицирует эмоциональное состояние на основе электрической активности мозга, справляясь с индивидуальными различиями между людьми.

Для обучения использовали две открытые базы данных — FACED и SEED, содержащие обезличенные ЭЭГ более 130 человек разных возрастов и полов. Команда собрала дополнительные данные: у 16 добровольцев одновременно фиксировали мозговую активность и видео, чтобы сопоставить результаты. Несмотря на то что паттерны эмоций в ЭЭГ сильно варьируются от человека к человеку, точность вышла стабильной — от 70 до 80%.

Систему планируют применять для оценки работоспособности операторов на критически важных объектах. Это транспортные узлы, где диспетчеры и водители не должны терять концентрацию, промышленные предприятия с высоким риском и оборонная инфраструктура. ИИ поможет в режиме реального времени выявлять эмоциональную нестабильность или снижение внимания, снижая вероятность ошибок в управлении сложными системами.

Работа опубликована в журнале Big Data and Cognitive Computing (Q1-категория). Она выполнена по госзаказу Минобрнауки России, что открывает путь к дальнейшим тестам и интеграции в цифровые помощники для охраны психофизиологического здоровья. Напомним, что ранее та же лаборатория разрабатывала системы распознавания эмоций по видео, речи и биомаркерам вроде пульса.